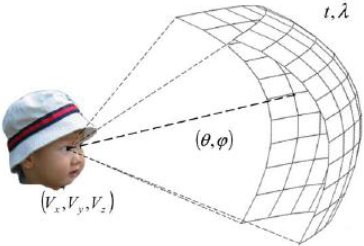

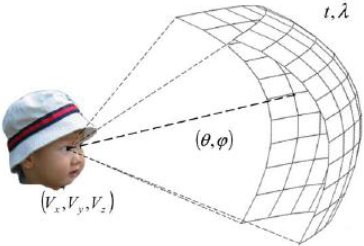

Fig. 5: Função plenóptica l(7). Extraído de [3].

Este paradigma de representação e reconstrução tridimensional baseia-se no conhecimento do valor (intensidade luminosa) de todos os raios ópticos emergentes da cena em direcção a um observador colocado numa posição arbitrária. Estes raios podem ser descritos pela denominada função plenóptica, de 7 graus de liberdade, l(7)(Vx, Vy, Vz, θ, φ, λ, t), que quantifica a radiância (intensidade luminosa por unidade de área) de um raio óptico de comprimento de onda λ na posição (Vx, Vy, Vz), com direcção (azimute e elevação) (θ, φ), no instante de tempo t (Figura 5).

|

|

Fig. 5: Função plenóptica l(7). Extraído de [3]. |

Fixando o tempo e a cor (a reposição destas duas variáveis pode ser feita, como nos sistemas de vídeo convencionais, pela captura com uma determinada frequência temporal (por exemplo 25 fps) e com três canais de cor (por exemplo RGB)), e assumindo ainda que o meio onde está inserida a cena (ar) não tem perdas (radiância constante ao longo de uma direcção), a função plenóptica passa a ter apenas 4 graus de liberdade, l(4).

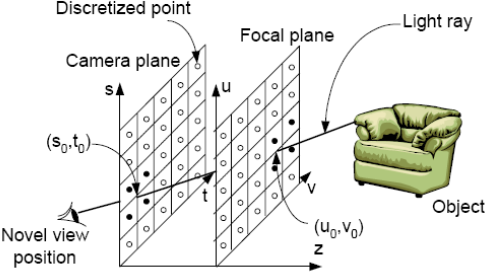

Sendo que um raio óptico fica completamente definido (nesta representação 4D) pelas coordenadas de intersecção do raio com dois planos, pode parametrizar-se a função plenóptica pela posição num plano (2D) de uma câmara que filme o raio, (s, t), e pelo pixel, (u, v) (também 2D), referente ao raio na imagem da câmara (Figura 6). É esta representação tetradimensional l(4)(s, t, u, v) da cena que é usada na prática, e que é designada habitualmente por Light Field [4].

|

|

Fig. 6: Parametrização da função plenóptica l(4). Extraído de [3]. |

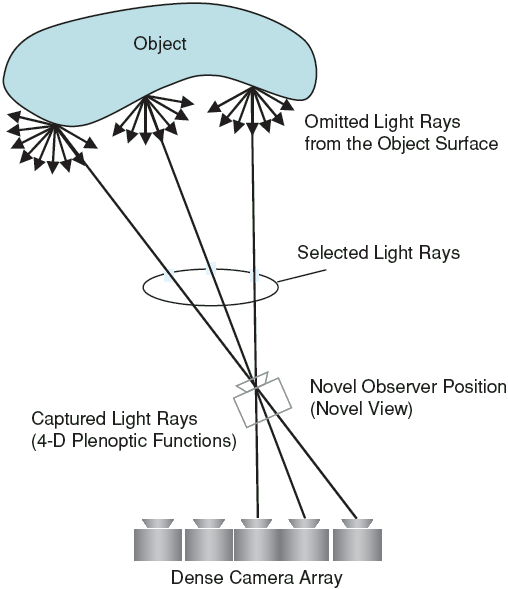

O bloco de representação 3D resume-se, portanto, à amostragem da função plenóptica l(4). A aquisição desta função é usualmente efectuada, tendo em conta a parametrização efectuada, recorrendo-se a um array denso planar de câmaras (a amostragem é inerente ao processo de aquisição). A reconstrução de uma vista arbitrária resume-se à selecção dos raios incidentes na posição virtual, que foram filmados pelo array de câmaras (Figura 7).

|

|

Fig. 7: Captura e renderização em Image Based Rendering. Extraído de [1]. |

Usando o teorema da amostragem, pode calcular-se a frequência de amostragem (resolução das câmaras e espaçamento entre câmaras) necessária para representar a função plenóptica sem perda de informação (impondo restrições quanto à largura de banda da cena filmada). Verifica-se que, para cenas reais, a densidade no espaçamento entre câmaras requerida pelo teorema da amostragem é demasiado elevada em relação às densidades que se conseguem implementar na prática (devido às elevadas dimensões físicas das câmaras). Assim, não se consegue obter uma reconstrução perfeita na fase de renderização e é necessário interpolar novos raios a partir dos raios capturados com o array de densidade insuficiente. Para este fim, é usual efectuar-se uma média entre as intensidades de raios vizinhos para interpolar um novo raio (em falta). Para descobrir quais são os raios vizinhos ao raio em falta, é necessário saber a profundidade a que o objecto filmado se encontrava em relação ao array aquando da captura. Essa profundidade pode ser medida com os processos já referidos na subsecção "Captura da Cena", ou então pode ser estimada tendo em conta a consistência de cor entre raios vizinhos (dado esses raios partirem todos do mesmo ponto da cena).

A vantagem deste método de representação 3D em relação ao método baseado em modelos geométricos reside no facto de se conseguirem obter imagens fotorealistas da cena com este método com complexidade computacional muito baixa (evitam-se reconstruções 3D), independentemente da complexidade (número e forma dos objectos) da cena. A grande desvantagem é a necessidade de amostragem densa da cena em questão para que não apareçam artefactos relacionados com a interpolação e oclusão de objectos na reconstrução. Esta elevada densidade repercute-se no elevado custo do sistema (são necessárias muitas câmaras) e na elevada quantidade de informação visual produzida pelo sistema. Quanto mais denso for o array (quanto mais vistas reais forem capturadas), maior tem de ser a taxa de compressão no codificador para suportar o armazenamento/transmissão da informação produzida, gerando mais artefactos de compressão. No sentido oposto, quanto menos denso for o array, com melhor qualidade se pode comprimir as imagens capturadas mas mais artefactos de interpolação/oclusão aparecem no processo de reconstrução. Existe portanto um balanço nestes sistemas entre o número de vistas naturais capturadas e a qualidade na compressão das imagens.

|

|