TECNOLOGIA

Aspectos Técnicos

Aspectos Técnicos

A Importância da Internet na Sociedade

A Importância da Internet na Sociedade

O Papel da World Wide Web na Partilha da Informação

O Papel da World Wide Web na Partilha da Informação

O Impacto Provocado pelo Aparecimento das Tecnologias de Banda Larga

O Impacto Provocado pelo Aparecimento das Tecnologias de Banda Larga

World Wide Web, Conteúdos Dinâmicos e Web 2.0

World Wide Web, Conteúdos Dinâmicos e Web 2.0

Tecnologia Flash

Tecnologia Flash

A Magia dos Codecs

A Magia dos Codecs

A Norma H.263

A Norma H.263

Aspectos Técnicos

São inúmeros os motivos que estão por detrás do grande sucesso do YouTube. Sem dúvida que muito se deve ao próprio momento que foi propício ao seu aparecimento. Factos como a globalização do mercado e da informação; a cobertura do acesso à Internet em banda larga pelos quatro cantos do planeta; a digitalização de todo o tipo de conteúdos; a vitalidade e as oportunidades emergentes do mercado online; a crescente capacidade de processamento, memória e armazenamento a preços cativantes; até mesmo a banalização dos dispositivos de registo vídeo/fotográfico, foram de todo factores determinantes.

Em Abril de 2005, um artigo da Forbes [11] revela que 40 milhões de vídeos são visualizados diariamente e que o tráfego gerado ronda os 200 Terabytes por dia, com um custo de sensivelmente 1 milhão de dólares mensais. Sabe-se ainda que nos meses de Junho e Julho estes valores duplicam. Um ano mais tarde, em Junho de 2006, um outro estudo publicado pelas empresas Nielsen/NetRatings [19] estima que já sejam 100 milhões o número de vídeos visionados diariamente e 65 mil novos vídeos adicionados em cada 24h.

Com números na ordem dos milhões de streams de vídeo visualizadas diariamente, não é preciso muito para chegar à conclusão que tal só é possível com a ajuda de tecnologia que consiga realizar uma espécie de “milagre digital”. A título de exemplo da complexidade entre mãos, vejamos o caso do vídeo: sabe-se que uma stream de vídeo com qualidade de difusão, ou seja, 576 linhas x 760 colunas a 25 imagens p/segundo e amostrada com o algoritmo Pulse-Code Modulation (PCM) [20], precisa de um débito de 166 Mbits/s para poder ser visualizada em boas condições. Com débitos desta ordem de grandeza por stream, actualmente as tecnologias de acesso comerciais de alto débito, que andam à volta dos 10Gb/s, não conseguiriam servir mais que umas dezenas de streams em simultâneo já não falando que estas nem se encontram ao alcance do utilizador comum. Então como é que o YouTube é possível?

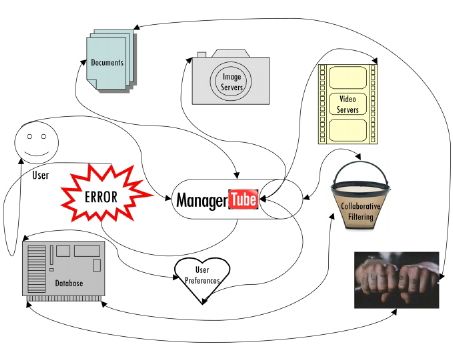

Imagem 2: Ilustração do funcionamento do YouTube feita pelos seus criadores

À parte dos aspectos sociológicos que estão intimamente ligados ao sucesso do YouTube, é importante salientar que sem os tais “milagres digitais” mencionados acima, este não seria de todo possível. Na realidade, estes devem-se aos grandes avanços tecnológicos que têm sido levados a cabo nas últimas duas décadas, nas mais diversas áreas. Muitas deles estão na génese do YouTube: a Internet; a World Wide Web; a dinamização dos conteúdos online (Web 2.0); as tecnologias de acesso de banda larga; a evolução dos codecs de voz, áudio, imagem e vídeo.

A Importância da Internet na Sociedade

As primeiras investigações no âmbito das redes de comutação de pacotes remontam os finais da década de 60. Na procura de uma rede altamente robusta e tolerante a falhas, é inaugurado o primeiro nó da rede ARPANET em 29 de Outubro de 1969, promovido e financiado pelo governo dos Estados Unidos da América, por intermédio da Agência de Projectos de Pesquisa Avançada de Defesa (DARPA). Posteriormente cria-se a primeira rede internacional de comutação de pacotes (International Packet Switched Service) e em meados de 1981 esta já atinge vários países da América do Norte, Europa, Austrália e Ásia. Em 1983 nasce a primeira rede alargada baseada no protocolo TCP/IP e muitas outras se seguem nos anos seguintes. Finalmente, é em 1990, com a interligação de muitas destas redes, que é tornada publica a primeira grande rede de dados à escala global, que foi baptizada de Internet.

Uma das grandes forças impulsionadoras da Internet, mais concretamente a camada de protocolos TCP/IP, deve-se à sua fácil implementação e simples adaptação às tecnologias de acesso existentes, como é o exemplo da tecnologia X.25, a mais popular da altura.

Com a criação da Internet em 1990, passou a ser possível transmitir livremente unidades de informação de uma ponta do planeta para a outra num curto espaço de tempo e virtualmente sem falhas. Deu-se início ao despertar da verdadeira era da comunicação digital. Apesar de já existirem redes de dados anteriores à Internet, está foi a primeira rede à escala global com caris público. Desde governos, banca, empresas, entre desconhecidos e amigos, qualquer pessoa é livre de se conectar, partilhando e consultando os mais variados conhecimentos, utilizando como forma de entretenimento, para fins comerciais ou mesmo até como forma de inspiração para criar modelos de negócio completamente inovadores.

Naturalmente, as tecnologias que compõem a Internet têm evoluído muito desde o seu aparecimento, principalmente nesta ultima década. Novas tecnologias de acesso mais eficientes e mais baratas, contribuíram para a banalização do acesso à Internet, com grande foco para o utilizador doméstico. Estima-se que actualmente esta possua mais de 1,1 mil milhões de utilizadores, sendo a América do Norte a região que actualmente possui a maior taxa de penetração com 69,7%, seguida da Austrália com 53,5% [4].

Com quase duas décadas de existência, já são inúmeros os tipos de serviços e conteúdos que podem ser encontrados na Internet: serviço de e-mail (smtp); Hypertext / World Wide Web (http); transferência de ficheiros (ftp); mensagens instantâneas; voz (VoIP); vídeo; etc.

O YouTube surge assim, num dos momentos mais importantes da Internet, do ponto de vista da própria sociedade, numa revolução social que foi baptizada de Web 2.0. Actualmente na World Wide Web, proliferam os sites de caris comunitário, em que qualquer pessoa pode ser responsável pela sua autoria. Com um serviço pioneiro que se distingue pela partilha e visualização de vídeos online, o YouTube tirou partido dos vastos laços preestabelecidos pela Internet, para abrir as fronteiras ao vídeo e à imaginação de qualquer pessoa, permitindo que seja o próprio mundo o espectador.

O Papel da World Wide Web na Partilha da Informação

Em 1990, enquanto trabalhava no âmbito do CERN (European Organization for Nuclear Research), Tim Berners-Lee foi responsável por um dos momentos mais importantes na história da Internet, ao criar a World Wide Web [21]. Esta ideia simples tem como base a adaptação do conceito de hypertext [22] à vasta rede à Internet. O hypertext já era bastante utilizado na altura em sistemas informáticos e consistia de uma “biblioteca alargada” de documentos que se encontravam interligados entre si, através de referências existentes no próprio texto que permitiam uma leitura fluida entre os diversos documentos.

O aparecimento da World Wide Web veio permitir de uma forma bastante simples a criação e publicação online de documentação, estimulando a partilha de conhecimento. Esta está organizada em páginas e encontra-se dispersa pelo mundo todo. Cada uma dessas páginas pode possuir ligações (links) com outras, formando conceptualmente uma “teia”/rede (web) de conhecimento a uma escala mundial.

O sucesso actual da World Wide Web deve-se bastante ao facto do CERN ter anunciando em 1993 que esta seria aberta ao mundo, livre de quaisquer encargos ou patentes da tecnologia, privilegiando assim a sua adopção. No âmbito desta decisão, em 1994 é criado o World Wide Web Consortium (W3C) cuja missão é a de regular, melhoria da qualidade e a criação/evolução dos seus standards. Actualmente estima-se [23] que existam 14 mil milhões de páginas online.

A evolução que os standards da Word Wide Web sofreram nos anos que se seguiram, permitiram que as páginas web pudessem ir bem mais além que simples repositórios de texto estruturado. Actualmente são inúmeras as suas potenciais aplicações, possibilitando um vasto tipo de conteúdos, como por exemplo: imagens; áudio; vídeo; conteúdos dinâmicos; conteúdos interactivos; jogos e todo o tipo de serviços online.

O YouTube conseguiu tirar partido desta evolução de uma forma fascinante, assentando todo o seu conceito num conjunto de tecnologias que nos dias que decorrem damos por garantidas. Actualmente, qualquer pessoa pode consultar o seu site e visualizar ou partilhar um vídeo, referenciá-lo ou ser referenciado por outras páginas e trocar impressões com outros utilizadores, explorando assim toda a grandiosidade e potencialidade de World Wide Web.

O YouTube goza assim de um momento tecnológico propício ao seu aparecimento, que jamais teria sido possível na década de 90.

O Impacto Provocado pelo Aparecimento das Tecnologias de Banda Larga

O termo “banda larga” [6] está normalmente associado às tecnologias de acesso que proporcionam débitos acima dos 56kpbs. Embora não tão conhecido, o termo “banda estreita” desempenha um papel fundamental na história das redes de comunicação, abrangendo todas as tecnologias de débito inferior e que ainda hoje predominam a cobertura de acesso à rede, numa óptica global. É comum associar as tecnologias de “banda estreita” aos modems de sinais analógicos (clássicos) que assentam sobre as linhas analógicas convencionais (linhas telefónicas/par de cobre).

A grande força impulsionadora da “banda larga” surge em 1986 com a norma RDIS (ISDN) [5], que possibilita uma comunicação totalmente digitalizada desde a central até ao terminal do utilizador e débitos nominais que vão desde os 64kbps por circuito até aos 2Mbps (E1 - 30 circuitos na Europa). Os primeiros vestígios da “banda larga” em Portugal surgiram mais tarde, já na década de 90. Muitas outras tecnologias têm surgido desde então, assentes nos mais variados meios: pares de cobre, pares entrançados, cabo coaxial, fibra óptica, acesso sem fios (rádio) ou mesmo a própria rede eléctrica.

As tecnologias de acesso com maior sucesso são sem dúvida a xDSL e o HFC (Hybrid-Fiber Coax), proporcionando um serviço de banda larga, por meio da rede telefónica existente e da rede de cabo coaxial recentemente instalada em Portugal, com débitos que já ascendem aos 24 Mbps. Estas tecnologias tiveram um impacto na forma como hoje em dia abordamos as comunicações, no âmbito das suas potencialidades e aplicações, como é o exemplo do caso de maior sucesso, o acesso à Internet. Trouxeram assim, um vasto leque de vantagens, tanto para as operadoras, na rentabilização das infra-estruturas, oferta de mais serviços a custos mais apelativos, como também para o utilizador, com maiores débitos e mais serviços a custos cada vez mais competitivos.Alguns exemplos destas vantagens são: competição feroz nos débitos oferecidos pelas operadoras, telefone/televisão/Internet por cabo/telefone (triple-play), VoIP, IPTV, televisão interactiva, etc.

O crescente aumento de débito oferecido pelas tecnologias de “banda larga”, têm vindo a possibilitar a introdução de novas aplicações na Internet. As que mais dependem da largura de banda são sem dúvida os conteúdos áudio e vídeo, que actualmente já podem ser consultados online pelo utilizador comum, de uma forma cómoda e quase instantânea. Este é sem dúvida, um dos factores que mais contribuiu para o sucesso do YouTube, onde a evolução tecnológica está na base da proliferação intensa dos conteúdos áudio e vídeo.

World Wide Web, Conteúdos Dinâmicos e Web 2.0

Com o crescimento da Internet também tem crescido o seu número de aplicações. Já se falou do impacto que a World Wide Web teve na difusão do conhecimento, no entanto, há um ponto de viragem na sua história que abre as portas aos limites da web. Com o aparecimento das tecnologias de dinamização de conteúdos web, um site deixou de ser um simples documento estruturado, para passar a ser um programa que processa pedidos e devolve respostas. Hoje em dia estas tecnologias estão na base de todos os serviços existentes na World Wide Web: portais; fóruns; compras; leilões; música; wikis; notícias; blogs; conteúdos de multimédia interactivos; jogos; etc.

Alguns exemplos dessas tecnologias são: php; ruby; java; javascript; ajax; dot.net e o flash.

A dinamização de conteúdos veio estimular uma verdadeira interacção entre o cibernauta e os próprios sites. O aparecimento compulsivo de novos conceitos de site com base na participação comunitária, como são os exemplos dos fóruns, blogs e wikis, conseguiram angariar milhões de curiosos, que desde então não mais pararam de contribuir e dinamizar o universo da World Wide Web. A esta revolução social os analistas apelidaram de Web 2.0 [29].

O YouTube é sem dúvida um dos mais mediáticos casos de sucesso, fruto da Web 2.0.

Imagem 3: A revolução social Web 2.0

Tecnologia Flash

A aplicação de streaming de video do YouTube foi programada usando a tecnologia Flash da Adobe, uma ferramenta que se tornou rapidamente popular desde a sua introdução em 1996. A sua popularidade deve-se principalmente à interactividade e animação que esta trouxe à World Wide Web.

Actualmente, o YouTube possibilita o upload dos vídeos em formato: WMV, AVI, MOV e MPEG. Após o seu upload, a stream de vídeo é convertida para a norma H.263 [26] pelo codec proprietário da Sorenson Spark [25]. O facto destas streams serem codificadas offline permite poupar enormes recursos computacionais.

O ficheiro codificado é enviado ao utilizador em formato FLV (Adobe Flash Video) e nele é encapsulado além do vídeo, os meta dados necessários ao funcionamento do player. Alguns desses meta dados informam há cerca da duração, número total de frames e frame rate do vídeo

É ainda possível carregar o player numa outra página, permitindo a visualização remota de vídeos alojados no YouTube, tornando-o ainda mais versátil.

A Magia dos Codecs

O codec [24] é uma noção que está intrinsecamente associada à comunicação digital. Esta, consiste num programa cuja funcionalidade básica é codificar ou descodificar um sinal analógico ou digital. As primeiras grandes aplicações de codecs consistiram na concepção de hardware com a finalidade de codificação e descodificação entre sinais analógicos e sinais digitais PCM (Pulse-code modulation), como por exemplo, o sinal de voz. Actualmente, estestambém se estendem ao software, realizando a codificação/descodificação dos mais variados tipos de sinais digitais: voz, áudio, imagem e vídeo.

A grande motivação por detrás dos codecs actuais está associada à redução do débito nominal necessário para transmitir uma stream de dados associada a um determinado tipo de conteúdo. A título de exemplo do impacto que estes têm tido, vejamos que sem esta redução, o download de uma imagem demoraria muitíssimo mais tempo, uma longa metragem ocuparia vários DVDs, ou ainda pior, seria praticamente impossível manter uma videoconferência em tempo real, devido às suas restrições temporais e grandes exigências em termos de débito. Estes ganhos só são então possíveis, devido à aplicação de técnicas específicas de codificação que permitem reduzir drasticamente a quantidade de bits necessários para representar a informação, mesmo que isso implique perdas na qualidade final. Alguns destes codecs empregam técnicas que exploram factores como a redundância temporal, redundância espacial, redundância estatística e a irrelevância.

Imagem 4: Diagrama do funcionamento do um codec

Já tivemos oportunidade de ver inicialmente que uma só stream de vídeo em qualidade de difusão poderia necessitar de um débito até 166 Mbits/s, um valor inaceitável quando se fala em centenas de fluxos simultâneos e até mesmo impossível para as tecnologias de acesso colocadas à disposição do utilizador comum. Portanto, podemos depreender que quanto à utilização de codecs, o YouTube não é excepção. Sendo este um serviço fundamentalmente baseado na transmissão de vídeo sobre a Internet, existem limitações técnicas que assim o exige. Só com o auxílio de um bom codec de vídeo, se consegue garantir que existe largura de banda suficiente para atender eficientemente os vários milhões de pedidos de streams de vídeo que ocorrem diariamente. No caso particular do YouTube, este utiliza o codec proprietário da Sorenson Spark [25] que respeita a norma H.263 [26].

A Norma H.263

O H.263 [26] é uma norma publicada pela ITU-T em 1996, que visa melhorar os algoritmos de codificação encontrados no H.261 [27], a sua norma antecessora, de forma a suportar a transmissão de vídeo digital com qualidade subjectiva aceitável, a débitos extremamente reduzidos. O débito de referência para esta norma está relacionado ao débito suportado na altura pela rede telefónica analógica/GSNT (General Switched Network Telephone) que rondava os 28,8kpbs, face aos 64 kbps base da rede digital RDIS, a referência da norma H.261.

Para cumprir com um débito tão ambicioso, a norma H.263 centrou-se na redução da quantidade de informação de overhead enviada, ao mesmo tempo que tentou melhorar as técnicas de codificação de forma a melhorar a qualidade de imagem oferecida pela norma antecessora. Alguns dos requisitos mais importantes estabelecidos foram: utilização na tecnologia actual; baixa complexidade (baixos custos de implementação); interoperabilidade com a norma H.261; bom controlo de erros; qualidade de serviço ajustável; suporte para redes fixas e moveis de baixo débito e interface videotelefonica ou multimédia (ex: computador pessoal). Este possui ainda um conjunto de opções avançadas que permitem obter uma taxa de compressão extremamente alta.

Imagem 5: Diagrama do funcionamento do codificador da norma H.263

Da mesma forma que a norma H.261, a norma H.263 baseia-se simultaneamente na predição entre imagens consecutivas (inter), tirando partido da redundância temporal, e na codificação DCT (Discrete Cosine Transform), explorando redundância espacial. Embora não seja um elemento de destaque no H.263, este utiliza ainda uma codificação entrópica que é comum às duas normas e permite tirar partido da redundância estatística, a codificação de Huffman [28].

A predição temporal permite caracterizar uma imagem à custa da imagem anterior, explorando assim um potencial factor de redundância temporal. A qualidade do algoritmo de predição usado determina o débito necessário para transmitir a nova imagem, possibilitando assim a obtenção de uma maior qualidade ou um menor débito para a mesma qualidade. Para a predição podem ser usadas 2 técnicas: transmissão de diferenças e compensação de movimento.

A técnica da transmissão de diferenças está na base da predição temporal e consiste, no lado do codificador, no envio das diferenças entre a imagem actual e a imagem anterior, evitando assim o seu envio na íntegra. No lado do descodificador, as diferenças recebidas são somadas à imagem anterior, obtendo a imagem actual, sem quaisquer perdas.

Imagem 6: Diagrama do funcionamento do descodificador da norma H.263.

Embora seja opcional, devido ao seu esforço computacional necessário, a compensação de movimento permite melhorar significativamente a predição temporal. Esta consiste na estimação do movimento que os macroblocos realizam no espaço da imagem, enviando para o receptor apenas os vectores representativos desse movimento. Já no lado do descodificador, através dos vectores de movimento recebidos, este reproduz os movimentos efectuados pelos macroblocos e reposiciona-os no local correcto, obtendo assim a imagem actual. No H.263 é usada uma precisão de meio pixel na compensação deste movimento, face à precisão de um pixel do H.261. Utiliza ainda uma abordagem mais evoluída do que a utilizada pelo H.261, que permite obter resultados mais satisfatórios na predição do movimento.

Por questões de eficiência na codificação, a imagem encontra-se dividida em macroblocos. Cada macrobloco possui quadro blocos de luminância e dois blocos de crominância. Cada bloco representa ainda um conjunto de 8x8 pixeis. Para permitir uma rápida sincronização da imagem após o erro, os macroblocos encontram-se agrupados em GOBs (Group of Blocks), tendo cada um deles o seu respectivo cabeçalho. A divisão da imagem em GOBs no H.263 difere do H.261, sendo ainda permitido a desactivação do cabeçalho dos GOBs, oferecendo assim um compromisso entre a recuperação de erros e a eficiência de codificação.

Para abranger o maior número de aplicações possíveis, a norma H.263 dispõem de uma variedade de resoluções espaciais bastante superior às definidas pela norma H.261, abrangendo desde os dispositivos de muito baixo débito/poder computacional até aos de maior debito/poder computacional. Disto isto, as resoluções possíveis são: sub-QCIF, QCIF, CIF, 4CIF e 16CIF.

A codificação DCT é uma das técnicas utilizadas para explorar a redundância espacial, à semelhança da norma H.261. Esta técnica permite tirar partido do factor de irrelevância subjectiva de cada bloco, através do ajuste dos níveis de quantificação aplicados, quando da passagem da imagem do domínio espacial para o domínio da frequência. É importante referir que esta codificação introduz perdas.

Por fim e sem aprofundar muito mais, existem ainda outras opções avançadas no H.263 que permitem optimizar e ajustar o seu funcionamento à medida das necessidades, principalmente através da enorme potencialidade existente em torno da predição de movimento, disponibilizando os seguintes novos modos de funcionamento: compensação de movimento sem restrições, predição de movimento avançado e tramas PB.

|

|

| Statistics

Video Views: 0Channel Views: 0 Subscribers: 0 |

Inbox

General Messages: 0 Friend Invites: 0 Received Videos: 0 |